Чат-боти небезпечні для здоров’я: люди відмовляються від лікарів на користь ШІ - результати досліджень шокують

Чому люди замінюють лікарів на ШІ?

Близько 42% людей використовують чат-боти зі штучним інтелектом для отримання медичних порад і часто не звертаються до лікарів після цього. Про це свідчить опитування організації KFF, опубліковане 25 березня, і так пише видання People. Частина користувачів консультується з ШІ навіть щодо психічного здоров’я.

Опитування охопило 1343 дорослих, і третина з них вже використовувала ШІ як альтернативу медичній консультації. При цьому значна частина після цього не звертається до фахівців, що викликає занепокоєння експертів. Молодь у віці 18–29 років у три рази частіше звертається до ШІ за порадами щодо психічного здоров’я, ніж люди старші 50 років.

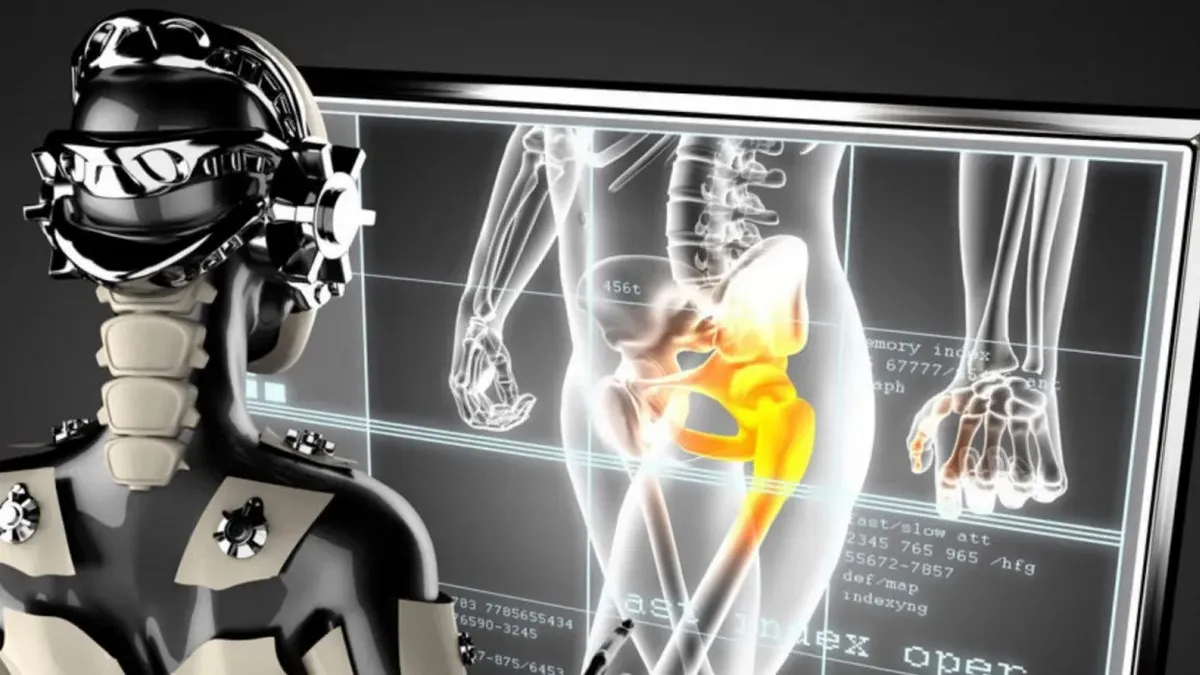

Лікар та штучний інтелект. Фото: startupdepot

Лікар та штучний інтелект. Фото: startupdepot

Чому експерти вважають ШІ небезпечним для пацієнтів?

Фахівці наголошують, що головна проблема штучного інтелекту - це впевненість навіть у помилкових відповідях. На відміну від лікаря, який може сумніватися та призначити додаткові обстеження, алгоритм часто дає чітку, але неправильну відповідь. Доктор Махмуд Омар пояснив:

«Лікар, який не впевнений, зробить паузу, замовить ще один тест. ШІ дає неправильну відповідь з точно такою ж впевненістю, як і правильна».

Експерти також звертають увагу, що пацієнти не можуть оцінити правильність відповіді без медичних знань. Це особливо небезпечно у випадках психічного здоров’я, де важлива жива взаємодія. Клінічна психологиня Ліанна Фортунато зазначила:

«Ми бачили деякі дійсно гучні проблеми у молоді або вразливих груп, які можуть опинитися в кризі, отримуючи поради у ШІ».

Багато експертів висловлюють занепокоєння через те, що люди звертаються до ШІ з будь-якими медичними питаннями. Це створює ризик поширення дезінформації та може завадити пацієнтам отримати належну медичну допомогу

Читайте по темі:

- Вікіпедія посилила правила щодо використання ШІ у статтях: що заборонила компанія.

- Компанія OpenAI закриває додаток для створення ШІ-відео Sora: став вірусним через відсутність обмежень.

- У McDonald's тепер працюють роботи: компанія поділилася першою точкою з автоматизованими процесами.